Nvidia đã phát hành chip Groq 3 LPU, giúp tăng tốc độ suy luận của các mô hình AI lên mức token.

Nvidia tiết lộ các tính năng mới của nền tảng Vera Rubin

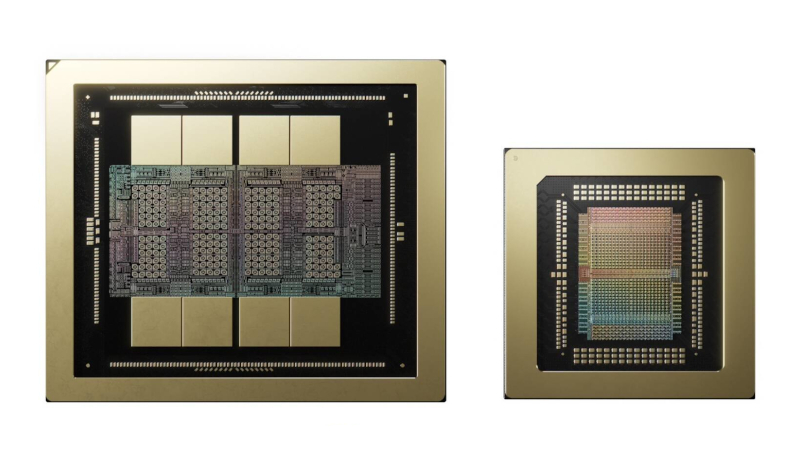

Tại hội nghị GTC năm nay, giám đốc điều hành Nvidia Jensen Huang công bố việc mở rộng nền tảng Vera Rubin. Các tính năng mới dựa trên tài sản trí tuệ được mua từ công ty Groq, và Rubin đã bao gồm chip *Groq 3 LPU* – bộ tăng tốc suy luận được thiết kế để phát token với tốc độ cao và độ trễ thấp.

Những gì đã có trong Vera Rubin

Nền tảng bao gồm sáu thành phần chính mà Nvidia tập hợp vào các hệ thống điểm và mở rộng lên các nhà máy AI lớn:

| Thành phần | Mô tả |

|---|---|

| GPU Rubin | Card đồ họa với 288 GB HBM4 |

| CPU Vera | Bộ xử lý trung tâm |

| NVLink 6 | Hệ thống mở rộng trong hệ thống |

| ConnectX‑9 | Bộ điều hợp mạng thông minh |

| BlueField‑4 | Bộ xử lý dữ liệu |

| Spectrum‑X | Switch mở rộng giữa các hệ thống với quang học tích hợp |

Groq 3 LPU hiện được thêm vào như một khối xây dựng mới, sẽ được sử dụng khi triển khai các hệ thống lớn.

Tại sao Groq 3 LPU nổi bật

Điểm khác biệt chính là kiến trúc bộ nhớ. Trong khi hầu hết các bộ tăng tốc sử dụng HBM làm bộ nhớ làm việc, mỗi Groq 3 LPU chứa 500 MB SRAM. So sánh:

| Tham số | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Dung lượng | 288 GB | 0,5 GB |

| Băng thông | ~22 TB/s | tới 150 TB/s |

Đối với các tác vụ suy luận nhạy cảm với băng thông, lợi thế của SRAM là rõ ràng. Đó chính là lý do Nvidia đã đưa Groq 3 vào Rubin – để tăng tốc độ phát token.

Tháp Groq 3 LPX

Trong tháp có 256 chip Groq 3 LPU, mang lại:

- 128 GB SRAM

- 40 PB/s tổng băng thông

- 640 TB/s giao diện trong hệ thống

Phó chủ tịch các giải pháp siêu mở rộng Ian Buck gọi tháp này là đồng xử lý cho Rubin, nhấn mạnh vai trò của nó trong việc nâng cao hiệu suất giải mã ở mỗi lớp mô hình và token.

Tác động đến các hệ thống đa tác nhân

Buck lưu ý rằng Groq 3 LPX sẽ là thành phần then chốt cho thị trường AI tương lai – các hệ thống đa tác nhân. Khi các tác nhân trao đổi dữ liệu trực tiếp, thay vì qua chatbot, yêu cầu phản hồi thay đổi: từ 100 token/s lên tới hơn 1 500+ token/s và cao hơn.

Đối thủ và triển vọng

Trong bài viết đề cập đến đối thủ – Cerebras, sử dụng Wafer‑Scale Engine (WSE) với SRAM khổng lồ cho suy luận thấp độ trễ. OpenAI đã triển khai Cerebras trong các mô hình tiên tiến của mình nhờ độ trễ có lợi.

Buck cũng lưu ý rằng sự xuất hiện của Groq 3 LPU có thể giảm phụ thuộc vào bộ tăng tốc Rubin CPX. Trong khi Nvidia tập trung vào tích hợp tháp Groq 3 LPX với nền tảng, cả hai chip đều nhằm mạnh mẽ suy luận mà không cần lượng lớn bộ nhớ GDDR7.

Kết luận:

Chip Groq 3 LPU mới và tháp LPX của nó củng cố Vera Rubin trong lĩnh vực suy luận thấp độ trễ, mở đường cho các hệ thống AI đa tác nhân nhanh hơn và cạnh tranh với những người chơi như Cerebras.

Asted Cloud

Asted Cloud

Bình luận (0)

Chia sẻ ý kiến của bạn — vui lòng lịch sự và đúng chủ đề.

Đăng nhập để bình luận